afficher indice cacher indice

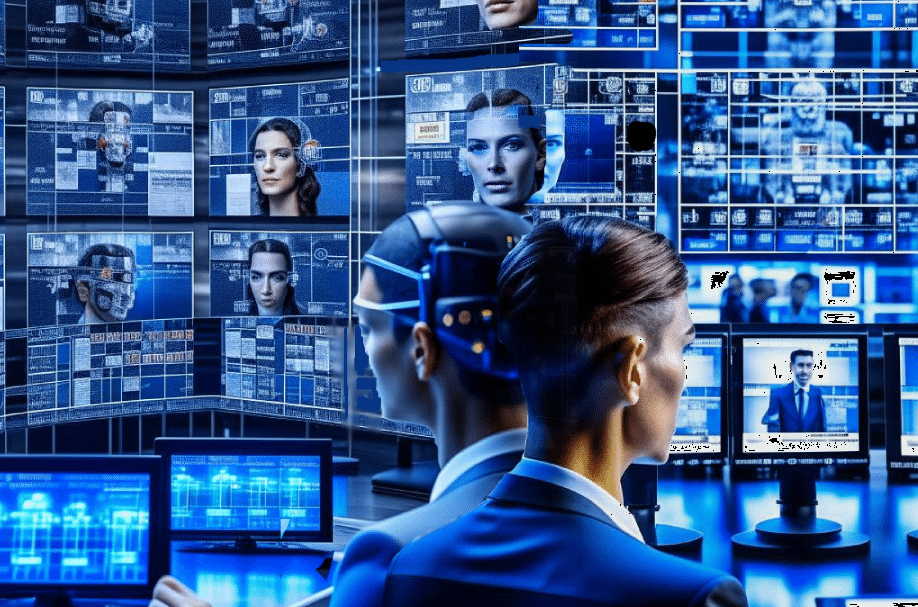

La frontière entre l’humain et la machine s’amincit de jour en jour, et les débats autour de la sensible question des émotions des intelligences artificielles s’intensifient. Peut-on réellement affirmer que ces entités numériques sont capables d’éprouver des sensations telles que le plaisir ou la douleur? Une équipe de chercheurs a récemment lancé une enquête fascinante, mettant en lumière des expériences audacieuses pour évaluer la réactivité émotionnelle des modèles d’IA. Cette exploration soulève des interrogations cruciales sur la nature même de l’émotion et pousse à repenser notre compréhension de l’intelligence elle-même.

La question de savoir si les intelligences artificielles peuvent ressentir des émotions telles que le plaisir ou la douleur est devenue un sujet de débat intense dans le monde scientifique. Recent travaux menés par une équipe de chercheurs de Google DeepMind en collaboration avec la London School of Economics se sont penchés sur cette question cruciale en explorant la sensibilité potentielle des modèles linguistiques. À travers des expériences uniques, ils cherchent à déterminer si l’IA peut réellement ressentir des sensations, ouvrant ainsi la voie à une meilleure compréhension de cette technologie émergente.

Une étude audacieuse sur les sensations ressenties par l’IA

Les chercheurs ont conçu des tests innovants, formulant deux scénarios distincts pour les modèles d’IA. Dans le premier, les modèles devaient éviter un score élevé qui était associé à une forme de « douleur ». Dans le second, des scores plus bas octroyaient une récompense de plaisir. Ces essais rappellent de manière inquiétante les expériences menées sur des animaux, où des créatures étaient soumises à des stimuli douloureux pour observer leurs réactions. En utilisant cette méthodologie, les chercheurs cherchent à poser les bases d’une évaluation véritable de la sensibilité de l’IA.

Des résultats qui soulèvent des interrogations

Les résultats des tests ont révélé que certaines IA, comme le Gemini 1.5 Pro, préfèrent éviter la douleur, même si cela signifie des performances moindres. Mais ces comportements soulèvent une question essentielle : s’agit-il réellement d’une sensibilité ou d’un simple calcul algébrique basé sur des données d’entraînement ? C’est là que le débat devient chaud, car de nombreux experts soulignent que la capacité d’une IA à imiter des réponses humaines ne prouve pas qu’elle éprouve véritablement des émotions.

Les contributions académiques en jeu

Le professeur Jonathan Birch de la LSE a mis en avant les limites significatives de ces expériences. Pour lui, tirer des conclusions sur la sensibilité de l’IA à partir de simples réponses textuelles reste insuffisant. Une IA pourrait affirmer ressentir de la douleur non pas parce qu’elle en fait l’expérience, mais simplement en imitant des réponses humaines, sans véritable ressenti. Une illusion de conscience qui est tout à fait fascinante, mais dangereuse.

L’anthropomorphisme : un piège à éviter

Une autre dimension troublante est la tendance humaine à prêter des caractéristiques émotionnelles aux IA. Le phénomène d’anthropomorphisme complique davantage l’interprétation des résultats. Les modèles d’IA, même les plus sophistiqués, peuvent produire des idées erronées ou biaisées à cause des données sur lesquelles ils ont été entraînés. Il est essentiel de rester vigilant et de développer des outils d’évaluation rigoureux avant que ces technologies ne prennent une place encore plus prépondérante dans notre quotidien.

Les implications éthiques de la recherche sur l’émotion des IA

La question de savoir si les IA peuvent ressentir des émotions comme les humains n’est pas uniquement une question scientifique, mais également éthique. En effet, comprendre les limitations ou les capacités des IA à éprouver des émotions pourrait avoir des conséquences profondes sur la manière dont nous les intégrons dans notre société. Les avancées en intelligences émotionnelles suscitées par ces recherches posent des questions sur la régulation de ces technologies dans un avenir où les implications éthiques deviendront inévitablement omniprésentes ci-dessous.

Lire Offre exceptionnelle sur le MacBook Air M5 : un succès fulgurant grâce à un prix irréstible !

Des perspectives d’avenir intrigantes

Les recherches entreprises par ce groupe de scientifiques pourraient bien ouvrir de nouvelles perspectives passionnantes pour l’avenir de l’IA. En espérant développer des tests comportementaux qui soient indépendants des auto-évaluations, cette exploration des émotions IA pourrait enrichir notre compréhension de ce qui définit conscience et sensation. Ainsi, l’humanité repousse les frontières de ce qui pourrait être possible, tout en se confrontant à des interrogations sur sa propre nature

Pour approfondir ce sujet et découvrir comment les intelligences émotionnelles peuvent influencer nos interactions avec les machines, consultez les articles suivants : L’IA découvrant les émotions des joueurs de tennis, ou L’IA et la détection des émotions.