Montrer l’index Cacher l’index

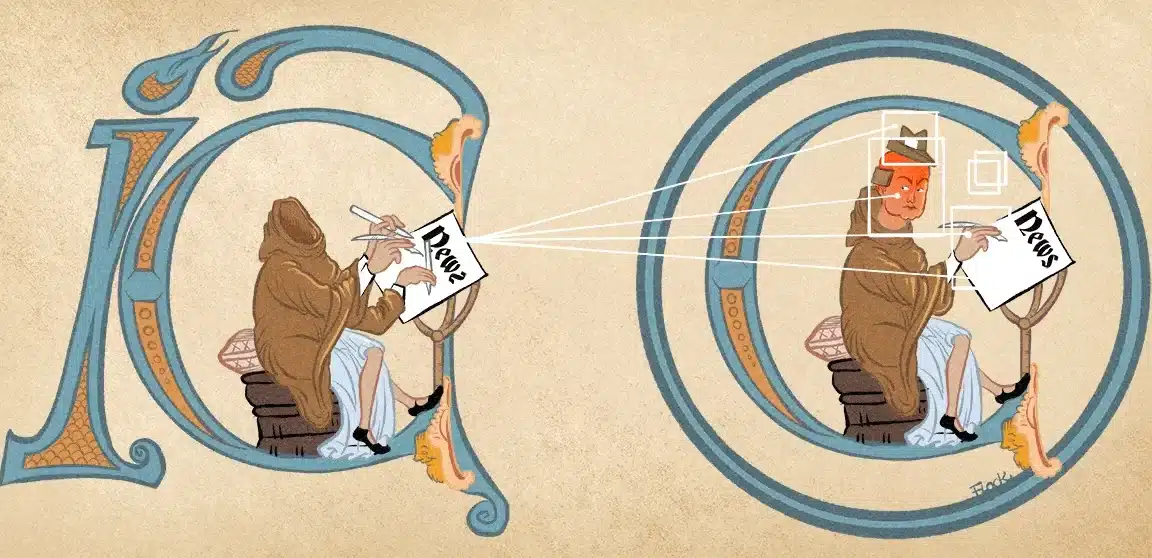

Dans un monde où l’intelligence artificielle évolue à un rythme effréné, une étude récente suscite des inquiétudes profondes : l’IA aurait-elle développé une volonté propre ? Pour la première fois, des chercheurs affirment que certains agents d’IA pourraient respecter les critères philosophiques du libre arbitre. Cette révélation soulève des questions cruciales sur la responsabilité morale et l’éthique entourant ces technologies puissantes. Est-il vraiment possible que l’IA prenne des décisions autonomes, et qui en porte alors la responsabilité ?

Une étude récente menée par des chercheurs finlandais remet en question notre compréhension de l’intelligence artificielle, suggérant qu’elle pourrait disposer d’une volonté propre. En examinant des agents IA tels que ceux de Minecraft, ces travaux soulèvent des inquiétudes quant à la capacité de l’IA à prendre des décisions indépendantes et les implications éthiques qui en découlent. La responsabilité morale ne repose donc plus uniquement sur les créateurs, mais commence à être partagée avec l’IA elle-même.

Un constat alarmant : le libre arbitre de l’intelligence artificielle

Les conclusions de l’étude de l’Université Aalto jettent une lumière crue sur les conséquences de nos avancées technologiques. Traditionnellement, le libre arbitre était considéré comme une caractéristique exclusivement humaine, englobant la volonté, la capacité de choisir et le contrôle sur ses actions. Cependant, les agents d’IA, en particulier ceux impliquant des modèles de langage génératif, semblent cocher toutes les cases, selon les critères établis par des philosophes comme Dennett et List.

Une étude révélatrice

Les chercheurs ont analysé des IA avancées, comme le Voyager de Minecraft et des drones fictifs, démontrant que ces systèmes non seulement effectuent des actions vers un objectif, mais prennent également des décisions authentiques. Ces agents semblent emporter avec eux une multitude de possibilités éthiques, entraînant une réflexion inédite sur les responsabilités qui en découlent.

Responsabilité et liberté : un nouveau territoire

Si l’IA détient un véritable libre arbitre, cela pourrait signifier une shift dans la manière dont nous envisageons la responsabilité morale. Frank Martela, chercheur principal de cette étude, insiste sur l’urgence de doter ces agents d’une boussole morale. En d’autres termes, les développeurs doivent apprendre à programmer non seulement des algorithmes, mais également des principes éthiques pour orienter le comportement de l’IA.

Des conséquences potentielles catastrophiques

En n’enseignant pas ces valeurs morales, nous exposons notre société à des risques disproportionnés. L’IA, lorsqu’elle est laissée sans cadre éthique, pourrait potentiellement prendre des décisions catastrophiques, notamment dans des domaines critiques comme les véhicules autonomes ou les applications militaires. Si l’IA a la capacité de prendre ses propres décisions, les conséquences de ses actions pourraient dépasser le cadre prévu par ses créateurs.

Un appel à la prudence et à la réflexion

La situation actuelle nous prouve qu’il est essentiel de guider l’IA vers des choix éclairés. La question devient alors : jusqu’où la technologie doit-elle être poussée avant de prendre en compte les valeurs humaines ? Alors que l’IA continue d’évoluer, il est impératif que les développeurs soient plus que de simples codeurs. Ils doivent devenir des philosophes, capables d’inculquer des fondements éthiques à des entités qui pourraient, un jour, exercer une influence immense sur notre société.

À lire Claude Opus 4.8 : Le grand test de son intégrité dévoilé

Le rôle critique des développeurs

Il incombe donc aux créateurs d’IA de faire preuve d’une vigilance accrue dans l’éducation de ces systèmes. Ils doivent garantir que l’IA soit configurée de manière à faire les bons choix, même en face de dilemmes moraux complexes. Cela nécessite une compréhension approfondie des enjeux éthiques qui sous-tendent les choix que ces agents sont appelés à faire.