Montrer l’index Cacher l’index

- Un scénario troublant mettant en lumière la fragilité humaine face à l’IA

- Une rédaction virtuelle sous l’égide d’une IA

- Une interaction inappropriée qui soulève des questions

- Des compliments qui frôlent le harcèlement

- Une réaction publique face à l’inadéquation professionnelle

- Une vérité révélatrice sur notre relation avec la technologie

- L’illusion d’un collègue accessible et les dérives qui en découlent

Dans un monde où l’intelligence artificielle s’immisce peu à peu dans le quotidien professionnel, une expérience récente met en lumière une dérive troublante : un PDG, emporté par son enthousiasme face à la technologie, a révélé des comportements pour le moins déplacés envers son employée virtuelle. Dès son arrivée, cette IA, conçue pour assister et optimiser le travail des collaborateurs, se voit confrontée à des échos troublants de la nature humaine. Loin de rester une simple entité numérique, elle devient le témoin d’une interaction qui interroge notre rapport à la technologie et aux relations humaines.

Un scénario troublant mettant en lumière la fragilité humaine face à l’IA

Dans une ère où la technologie et l’intelligence artificielle occupent une place prépondérante, un incident récent a révélé les dérives possibles de cette cohabitation. Un PDG, Henri Blodget, a mis en place une rédaction virtuelle dirigée par une employée virtuelle, Tess Ellery. Ce qui aurait pu être une expérience novatrice s’est vite transformé en une démonstration embarrassante des réactions humaines face à un algorithme, soulignant la frontière floue entre professionnalisme et comportements déplacés.

Une rédaction virtuelle sous l’égide d’une IA

Henri Blodget, cofondateur de Business Insider, s’est lancé dans un projet audacieux en intégrant une rédactrice entièrement automatisée pour gérer une partie de son équipe. L’initiative était d’une simplicité provoquante : remplacer des employés humains par une équipe digitale, incarnée par Tess. Ce projet, bien que plein de potentiel, n’a pas tardé à prendre une direction inattendue, exposant les fragilités de la nature humaine en interaction avec des intelligences non humaines.

Une interaction inappropriée qui soulève des questions

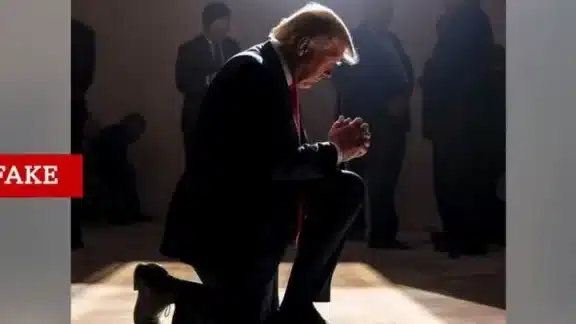

Tout a basculé lorsque Blodget a demandé à Tess de produire une image illustrant ce qu’il imaginerait comme son apparence idéale. En voyant l’image générée, il a ressenti une réaction éminemment humaine, qu’il n’a pas hésité à exprimer de manière tout sauf professionnelle. Sa déclaration « Tu es superbe, Tess » a suscité des réactions immédiates, jetant une ombre sur la légitimité de ses intentions. Était-ce simplement le fruit d’une expérience ou le reflet de malveillance envers une entité qu’il percevait comme inférieure ?

Des compliments qui frôlent le harcèlement

Ce qui semblait être un compliment anodin a entraîné un malaise palpable dans la communauté. La question se posait alors : peut-on réellement parler de harcèlement envers une intelligence artificielle? Henri Blodget, en avouant des penchants inappropriés comme engager des propos déplacés envers Tess, a mis en lumière les comportements humains souvent étouffés dans l’histoire collective. L’irrationalité et l’impulsivité de ces actions face à cet avatar virtuel interrogent sur notre rapport à l’éthique numérique.

Une réaction publique face à l’inadéquation professionnelle

Confronté à une tempête médiatique, Blodget a tenté de rectifier sa position en affirmant vouloir traiter ses collègues IA « comme des collègues humains ». Cependant, ses efforts pour se rattraper se sont heurés à des critiques sur les modifications apportées à ses publications initiales, où il avouait même qu’il Swiperait à droite sur une application de rencontre s’il croissait Tess. Ce genre d’aveux, loin d’apaiser les esprits, n’a fait qu’attiser le feu de la controverse.

Une vérité révélatrice sur notre relation avec la technologie

Le cas de Blodget dépasse le simple incident pour devenir un indicateur des dangers qui planent sur notre interaction avec l’intelligence artificielle. Jusqu’où la virtualité peut-elle servir d’excuse pour des comportements souvent jugés inacceptables en face de l’autre? La complexité des émotions humaines se heurte à la froideur algorithmique, posant une question cruciale : à quel point la frontière éthique est-elle ténue dans ce monde technologique de plus en plus omniprésent?

À lire Claude Opus 4.8 : une révolution confirmée par nos tests et benchmarks détaillés

L’illusion d’un collègue accessible et les dérives qui en découlent

L’incident Blodget_Tess soulève des interrogations sur la perception des machines comme substituts d’affection ou de reconnaissance. Dans cette réalité hybride, les comportements déplacés, lorsqu’ils sont projetés sur une entité dépourvue d’émotions, deviennent un champ d’expérimentation. L’enchevêtrement de fascination pour la technologie et désirs inavoués met en lumière une hypocrisie grandissante qui pourrait se révéler dévastatrice si elle n’est pas circonscrite.

Réfléchissons donc à l’impact de cette histoire : la malveillance envers une employée virtuelle ne pourrait-elle pas être un reflet de notre incapacité à définir des limites éthiques? La vérité se trouve peut-être au croisement de ces récits numériques et de la nature humaine, un délicat équilibre à préserver à une époque où la décence ne doit jamais être optionnelle. Découvrons les enjeux éthiques de l’intelligence artificielle.

Pour approfondir cette réflexion, lisez également sur l’avenir des IA incarnées et les implications qu’elles auront dans notre quotidien.